Blackwell Ultra: Nvidia GB300 ha 288 GB HBM3e e 1,4 kW per GPU 46 commenti

Immagine: Nvidia

I dati tecnici per l’aggiornamento a Blackwell Ultra provengono dalla catena di fornitura taiwanese. Nvidia aveva già annunciato l’aggiornamento di metà ciclo dell’architettura Blackwell al Computex di giugno, e ora vengono rivelati i dettagli per il GB300 come la quantità di HBM3e installati (288 GB) o il consumo per GPU (1.400 watt).

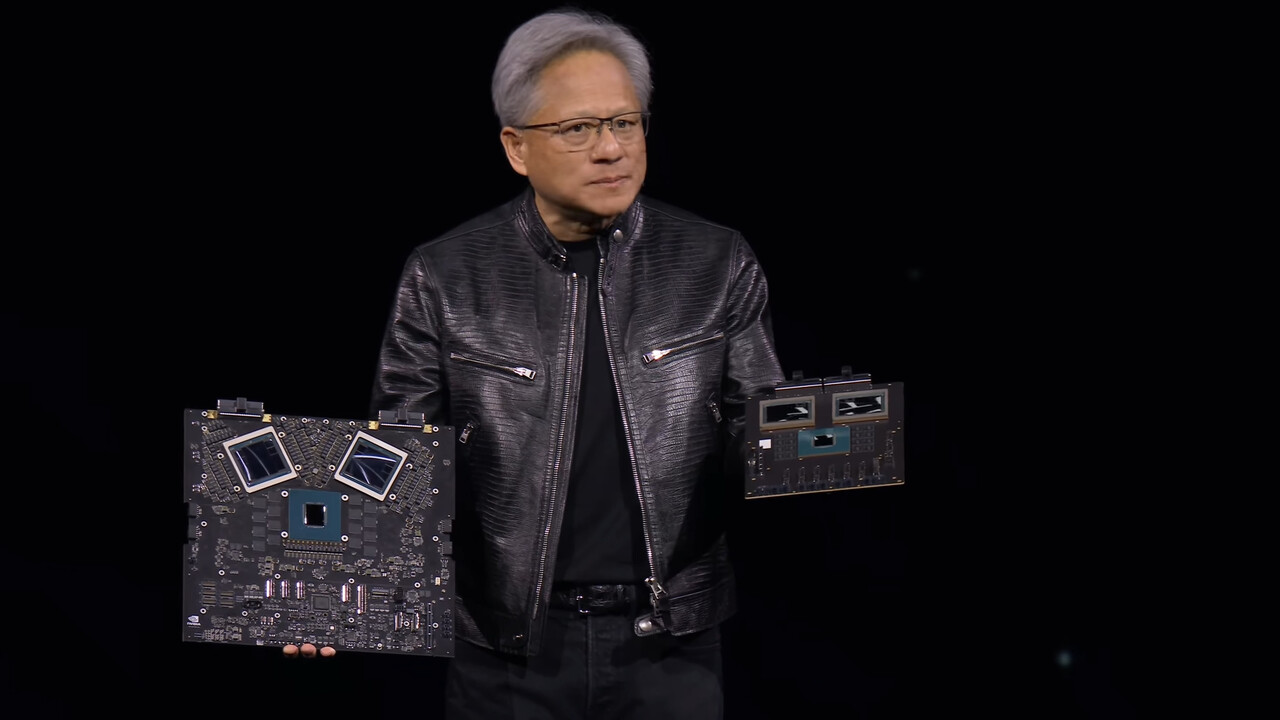

Il produttore ha annunciato agli investitori circa un anno fa che Nvidia avrebbe accelerato il ritmo di introduzione di nuove soluzioni per il supercalcolo AI. Durante il keynote del Computex nel giugno di quest’anno, il CEO Jensen Huang è stato sorprendentemente aperto e ha dato al pubblico un’idea dei successori di Blackwell, Blackwell Ultra, Rubin e Rubin Ultra per i prossimi anni.

Blackwell Ultra con HBM3e da 288 GB

Di conseguenza, l’aggiornamento di metà ciclo del Blackwell Ultra è previsto per il prossimo anno. A questo scopo Nvidia aveva già annunciato ufficialmente la funzionalità “8S HBM3e 12H”. Ciò significa: vengono utilizzati 8 stack HBM3e, ciascuno con 12 strati. Si prevede che l’espansione di memoria per GPU passerà dagli attuali 192 GB a 288 GB, riferisce l’Economic Daily di Taiwan con riferimento alla catena di fornitura.

Tuttavia, la cifra di 288 GB non sorprende, dato che Blackwell (senza Ultra) attualmente utilizza 8 stack di HBM3e, ciascuno con 8 layer, portandolo a 192 GB con il 50% di layer in più con Blackwell Ultra significa il 50% di memoria in più e quindi 288 GB .

Il TDP aumenta moderatamente

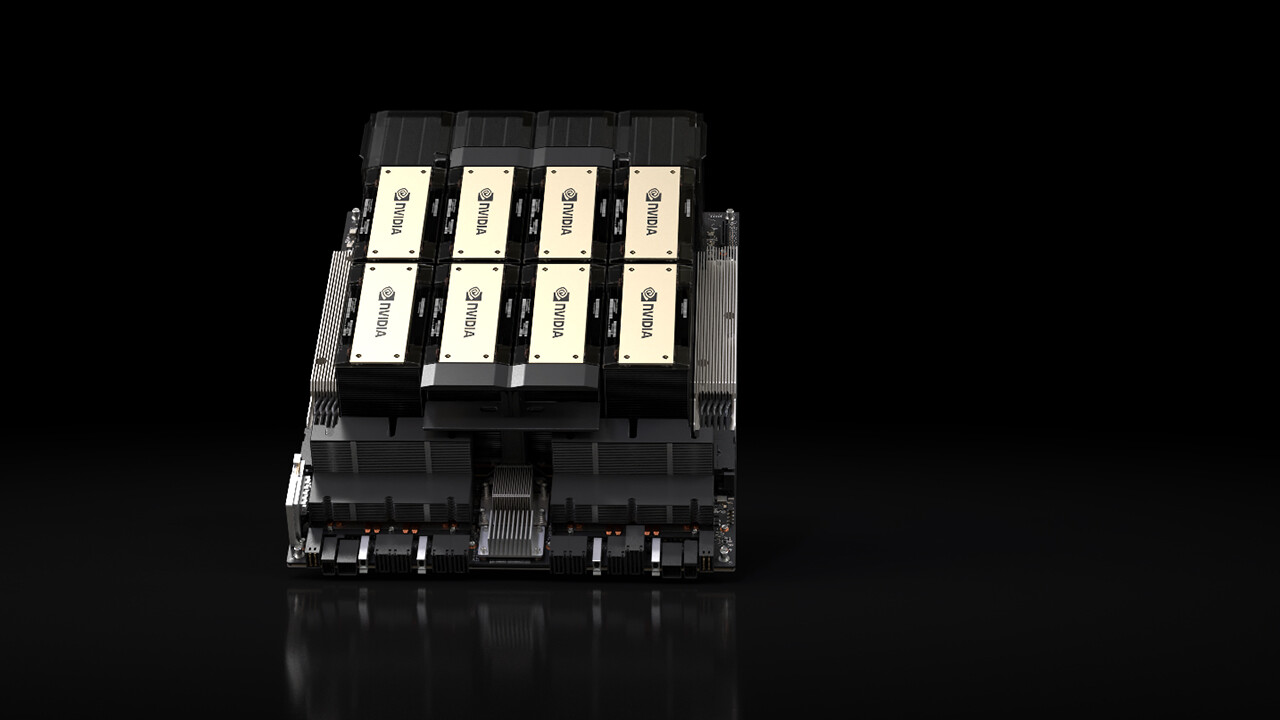

Il rapporto dell’Economic Daily si concentra principalmente sul GB300, il successore del superchip GB200. Così Nvidia chiama la scheda con due GPU B200 e una CPU Grace. 36 di queste schede costituiscono il GB200 NVL72, un rack denso e raffreddato ad acqua con 72 GPU Blackwell, 36 CPU Grace, HBM3e da 13,5 TB e fino a 1.440 PetaFLOPS di prestazioni (FP4 Tensor Core Sparse). Ogni carta Superchip ha un TDP configurabile di 2.700 watt. Questo è importante quando si tratta di Blackwell Ultra.

L’articolo elenca un TDP di 1.400 watt per la GPU B300. Sembra molto, ma non è molto più di B200. Due GPU Blackwell Ultra raggiungerebbero un massimo di 2.800 watt, e sarebbe poi necessario aggiungere la CPU Grace e altri componenti della scheda per poter confrontare i consumi con il precedente Superchip GB200. È prevedibile che il consumo per carta sarà più elevato, ma la differenza non sarà drammatica se la confrontiamo con l’aumento delle prestazioni. Le prestazioni della FP4 aumenterebbero del 50% a 2.160 PetaFLOPS con Blackwell Ultra quando si utilizza un’accelerazione scarsa.

LPCAMM per il processore Grace

Oltre all’HBM3e delle GPU, su ogni Superchip GB200 sono saldati anche 480 GB di LPDDR5X per il processore Grace. La prossima generazione introdurrà il modulare LPCAMM, destinato fin dall’inizio a laptop, desktop e server.

Modifiche al raffreddamento e allo stoccaggio dell’energia

Per i nuovi server AI dotati di Blackwell Ultra, si prevede che il numero di disconnessioni rapide universali (UQD) per il raffreddamento ad acqua aumenterà, rendendo il sistema più modulare. Nei nuovi rack verrà creato spazio anche per unità di backup a batteria (BBU) e supercondensatori per utilizzare questa energia per attenuare le interruzioni.

Si prevede che la rete raddoppierà a 1,6 Tbps

Inoltre, Nvidia prevede di raddoppiare la prossima velocità di rete portandola a 1,6 Tbps. L’Economic Daily mette in campo un aggiornamento dal vecchio adattatore ConnectX-7 InfiniBand al ConnectX-8. Secondo la tabella di marcia del Computex di giugno, erano previsti 1,6 Tbit/s solo per la piattaforma Rubin e il suo ConnectX-9, attesi per il prossimo anno. ConnectX-8 è già utilizzato anche nelle attuali soluzioni Blackwell e fornisce una larghezza di banda di 800 Gbps.

Argomenti: Schede grafiche Intelligenza artificiale Nvidia Nvidia Blackwell Fonte: Economic Daily

Ingegnere di formazione, Alexandre condivide le sue conoscenze sulle prestazioni delle GPU per gaming e creazione.